При переносе сайта на новый домен или его переезде компания рискует потерять больше половины трафика из поисковых систем. Если не позаботиться о мерах предосторожности заранее, то придется в экстренном порядке исправлять недочеты. Но даже если все быстро переделать, посещаемость вернется к прежнему уровню только через три или четыре недели. Рассказываем, какие ошибки допускают чаще всего и как их избежать.

Фильм «Один дома 2: Потерянный в Нью-Йорке» показывает, что все можно исправить

1. Разрешили поисковикам индексировать тестовый домен

Ошибка: во время разработки подключили тестовый поддомен, но забыли закрыть его от индексации. Потом опубликовали готовый проект на основном домене, но поисковый робот уже видел все материалы на другом домене, поэтому посчитал основной ресурс дублем, снизил его позиции в выдаче.

Как исправить: до создания нового ресурса на тестовом домене, закрыть его от индексации поисковыми роботами. Чтобы это сделать, создайте текстовый файл с названием robots.txt, внутри которого напишите:

User-Agent: *

Disallow: /

И положите его в корневую папку. Если тестовый домен уже проиндексировался, то его нужно этим же способом закрыть от роботов.

Около месяца займет восстановление позиций основного домена

2. Забыли про счетчики Метрики, настройку целей, Гугл Аналитикс

Ошибка: не подключили счетчики систем аналитики, не разметили цели. Поисковикам важно иметь доступ к аналитике, чтобы оценивать юзабилити.

Решение: при переносе на основной домен или при переезде на новый, добавьте счетчики систем аналитики Яндекса, Гугла, чтобы поисковики могли анализировать поведение посетителей. Настройте хотя бы пару целей: добавил товар в корзину, оформил заказ, подписался. Так поисковикам будет понятней, нашел ли пользователь то, что ему нужно или нет.

3. Оставили часть страниц на старом или тестовом домене

Проблема: не перенесли часть страниц со старого домена, потому что они не вписываются в новый дизайн. Вместе с ними ресурс потеряет часть поискового трафика, а бизнес – прибыли.

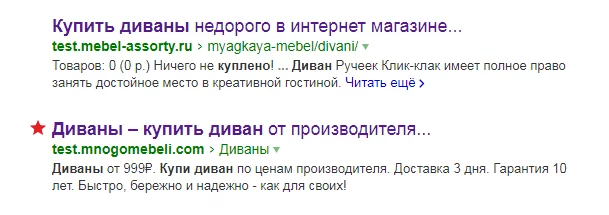

Как быть: придумайте, как сохранить все страницы. А чтобы быстро найти потерянные разделы, сделайте таблицы соответствия: урлы по старой версии и урлы с новой в две колонки друг напротив друга. Такой список легко сделать с помощью сервиса Screaming Frog SEO Spider. Бесплатно можно проверить 500 урлов.

В таблице сразу видно, какие урлы забыли перенести

Такой анализ поможет понять, какие разделы потерялись, стоит ли создавать их в новой версии. Если раздел приводил много посетителей из поиска, то перенесите. Если нет, то просто настройте 301 редирект на главную или схожую по тематике страничку.

4. Забыли про редирект

|

Редирект – это автоматическое перенаправление посетителей с одного урла на другой. |

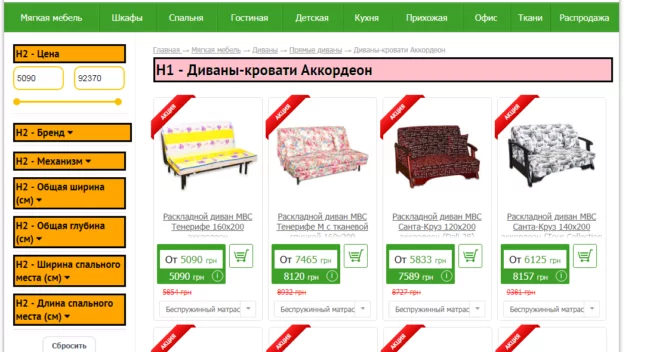

Что случилось: при редизайне поменяли структуру.

Пример

Фитнес-тренировки с собственным весом –> Функциональный тренинг

Табата – > Жиросжигающее кардио

Танго, Зумба, Бели-дэнс –> объединили в один раздел Фитнес-танцы

Но изменение структуры не меняет результаты поисковой выдачи, а, значит, там по-прежнему показываются старые разделы. Пользователь ищет «танго», видит этот раздел в поисковой выдаче, жмет, а попадает на заглушку с 404-ошибкой, уходит. А поисковик решает, что этот ресурс не соответствует запросу и понижает его в выдаче.

Как скорректировать: настроить 301-й редирект для каждого изменившегося раздела. Теперь, когда посетитель видит в выдаче раздел Танго и нажимает, он автоматически перенаправляется на Фитнес-танцы, все довольны.

Если страница была удалена без замены, то настройте редирект на главную. Тогда пользователи будут попадать на сайт, а поисковики перестанут снижать позиции в выдаче.

5. Потеряли наработки seo-специалиста

Проблема: не перенесли мета-теги, текст, заголовки, убрали качественно оптимизированные разделы.

Когда seo-специалист работает над оптимизацией, он под определенные запросы или их группы создает отдельные страницы. Затем прописывает для них мета-теги, создает текст, добавляет видео, фото, таблицы. Если не перенести эту информацию при переезде, то раздел потеряет свои высокие позиции в выдаче.

Решение: переносить мета-теги, текст с заголовками, другие материалы. Проверить, чтобы все странички были на месте. См. пункт 3.

6. Не открыли доступ для роботов в новой версии

Проблема: всё перенесли, но файл, запрещающий роботом индексацию, не удалили. В итоге проект запустился, работает, но для поисковиков остается невидимкой. Естественно, трафика из поиска ноль.

Решение: сразу после переноса проверить файл robot.txt и убрать его со всех важных страниц. Или убрать сразу, как только вспомнили, что забыли это сделать.

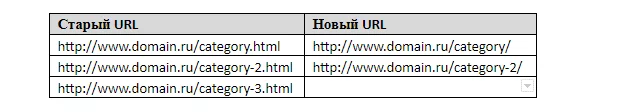

7. Не сделали страницу 404

Проблема: если страница удалена, пользователь видит лишь информацию о том, что ее не существует и уходит. Поисковик видит, что у проекта куча дублирующихся бесполезных разделов, и понижает позиции.

Решение: прописать настройки сервера, чтобы при обращении к удаленной или несуществующей странице, посетитель попадал на HTTP/1.1 404 Not Found. И ему показывалась специальная заглушка с 404 ошибкой.

Чтобы не терять посетителей, добавьте ссылки на главную и блок с популярными товарами или акциями

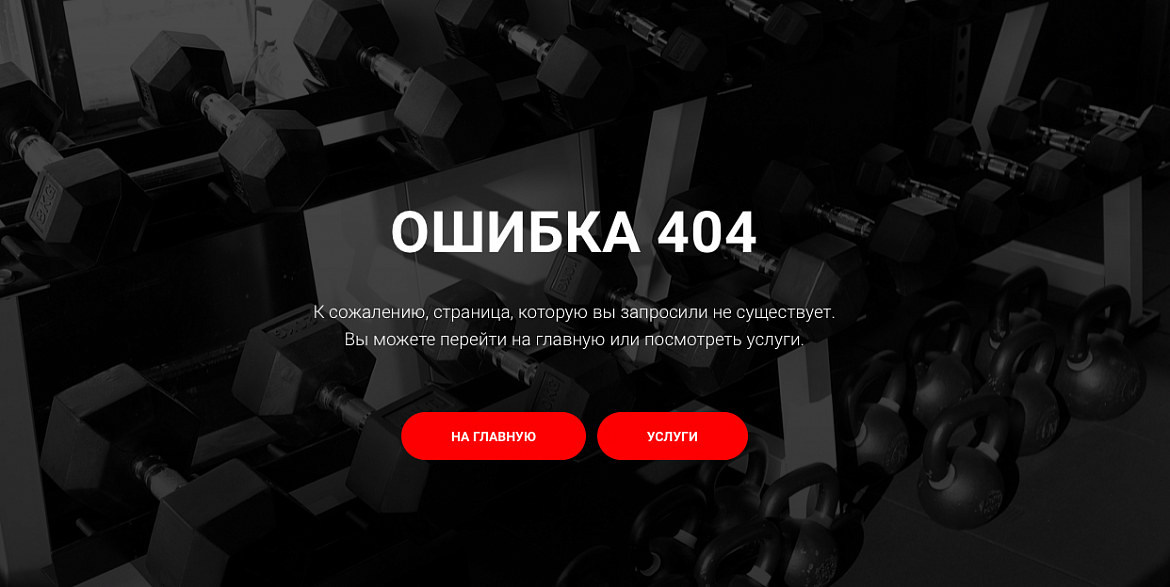

8. Неправильно прописали заголовки

Ошибка: вообще не перенесли заголовки или перенесли, но неправильно отформатировали. Поисковики следят за заголовками в тегах от <h1> до <h6>. Именно отформатированные заголовки показывают роботу, о чем, собственно, идет речь на этой странице. Самым важным считается заголовок первого уровня – <h1>. Еще этот элемент помогает пользователям ориентироваться, повышая юзабилити.

Как быть: для каждой странички обязательно пропишите заголовок первого уровня в теге <h1>, но только один. Важно, чтобы заголовки не были элементами навигации. А еще лучше, если атрибуты, вложенные стили будут прописаны отдельно во внешней таблице CSS.

Здесь заголовки работают как элементы навигации. Это плохо!

9. Не проверили код

Проблема: слишком сложный код с ошибками затрудняет индексацию сайта.

Решение: прогоните код сайта через валидатор: FXN или W3C. Сервис покажет, что нужно улучшить.

10. Забыли про карту сайта

Проблема: не сделали XML-карту или сделали неправильно. Карта нужна для того, чтобы поисковый робот быстро проиндексировал все страницы сайта. Важно, чтобы карта была сделана без ошибок.

Как исправить: добавьте карту, предварительно проверив, чтобы в ней не было:

- повторяющихся страниц;

- разделов, которые не нужно индексировать;

- разделов 404, 410, редиректов;

- неканонических версий;

- запрещенных к индексации разделов.

Подробнее о правилах оформления XML-карт советуем читать на официальных сайтах Гугла, Яндекса в разделах для веб-мастеров.

11. Использовали технологии AJAX, JavaScript в навигации

Ошибка: скрипты в навигации не дают поисковому роботу перемещаться, а значит негативно влияют на индексацию.

Корректировка: некоторые браузеры не поддерживают эти технологии, поэтому важно подготовить HTML-версию.

12. Оставили кучу редиректов, битых ссылок

|

Битая ссылка – это урл, который никуда не ведет или ведет на уже удаленный контент. Посетитель переходит, видит ошибку или служебную страницу. |

Ошибка: оставлять вложенные редиректы. Это когда пользователь кликает на раздел, а его автоматически перенаправляют на другой, а потом на еще один или несколько. Такие цепочки создают лишнюю нагрузку на поисковых роботов, тормозят загрузку. А еще метод часто используется мошенниками, поэтому вызывает подозрения у внимательных посетителей.

Решение: сократите цепочки из 301-х редиректов до одного перенаправления. Найдите, удалите или скорректируйте битые ссылки.

13. Не отключили коды сессий в урлах

Ошибка: некоторые CMS – системы управления содержимым сайта или движки – по умолчанию добавляют код сессии в урл. Для каждого пользователя этот код уникальный, из-за чего у странички появляется бесконечное число дублей, которые плохо влияют на ранжирование.

Как исправить: отключить добавление кодов, а существующие дубли закрыть от индексации в файле robots.txt, добавив туда одну строку текста: Disallow: /*PHPSESSID=

14. Не задали основные адреса

Ошибка: не задали основные адреса, из-за чего разделы доступны сразу по нескольким.

Пример

с www / без www;

со слешем в конце / без слеша;

http / https;

есть index.php в конце / нет.

Кажется, что эти странички не отличаются, но для поисковых систем это разные разделы, которые по содержанию дублируют друг друга.

Как исправить: выберите, какие адреса считать основными, и настройте редиректы на них. А дубли закройте от роботов.

15. Продублировали текст на страницах поиска

Проблема: если товаров слишком много, используют несколько страниц для их размещения - 1, 2, 3. Это называется пагинация. Если на каждой из таких страниц текст будет одинаковым, то поисковик решит, что это дубли и понизит позиции.

Решение: показывать текст только на странице 1.

Проблема: один текст на всех страницах пагинации

16. Сделали несколько урлов с разным регистром

Ошибка: считать, что регистратор не имеет значения. Урлы www.example.com/Primer и www.example.com/primer считаются разными.

Как исправить: странички должны быть доступны только по урлам, где все буквы в нижнем регистре. Если есть дубли, нужно настроить 301 редирект.

При переносе проекта на новый домен или редизайне есть риск допустить ошибки, которые приведут к потери трафика, а значит прибыли. Чтобы этого не произошло, доверяйте перенос только профессионалам.

Чек-лист

|

Проверить |

Сделать |

Убрать |

|

Все ли страницы перенесли Ошибки в HTML-коде Редиректы, битые ссылки Заголовки, их форматирование Регистры урлов

|

Запрет на индексацию тестового домена Открыть доступ роботу на основном домене Счетчики аналитики, цели 404-страницу Карту сайта Основные адреса |

Дубли страниц AJAX, JavaScript в навигации Коды сессий в урлах

|